刷屏朋友圈的QQ小世界二次元生成器原理解密

只需要上传一张照片,一键即可穿越二次元。火遍国内外的 QQ 小世界二次元生成器——“异次元的我“背后原理解密。

1 项目介绍

今年是人工智能领域成果井喷的一年,前有 AI 画画后有 chatGPT,纷纷迅速走红网络。早在今年五月,QQ 影像中心推出的国内第一款基于 AI 画画技术的”AI 恋爱专属画”520 活动就在小世界走红,最近新推出的“异次元的我”二次元形象生成器更是火遍国内外。

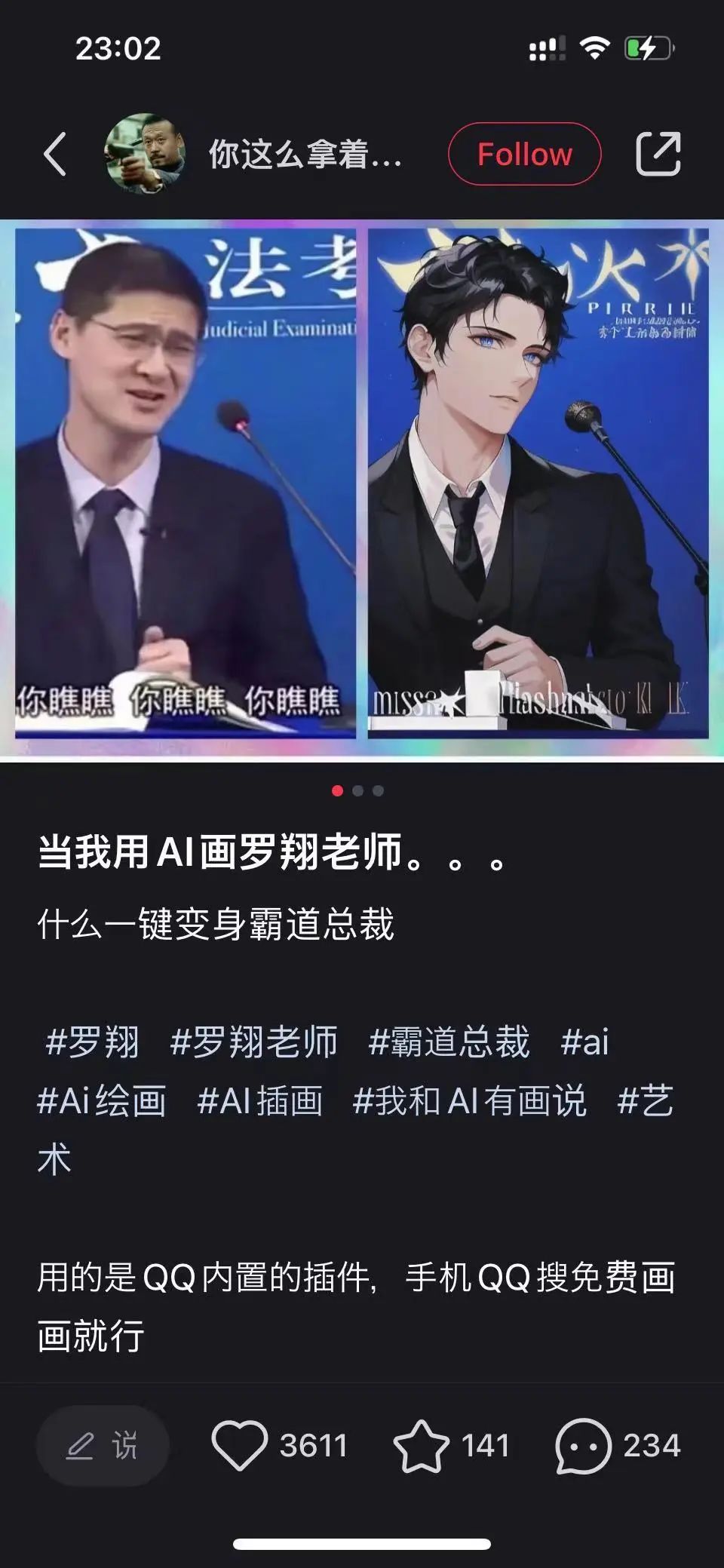

你可以看到罗翔老师一键变身霸道总裁:

这一切都是怎么做到的呢,本文带你揭秘“异次元的我”背后的原理和技术细节。

2 原理简介

2.1. 图像生成模型

近年来,扩散模型(Diffusion Model)在图像生成领域中蓬勃发展,例如 OpenAI 的 GLIDE 和 Google 的 Imgen,都采用了基于扩散模型的 pipeline 来获得高质量的图像生成结果。

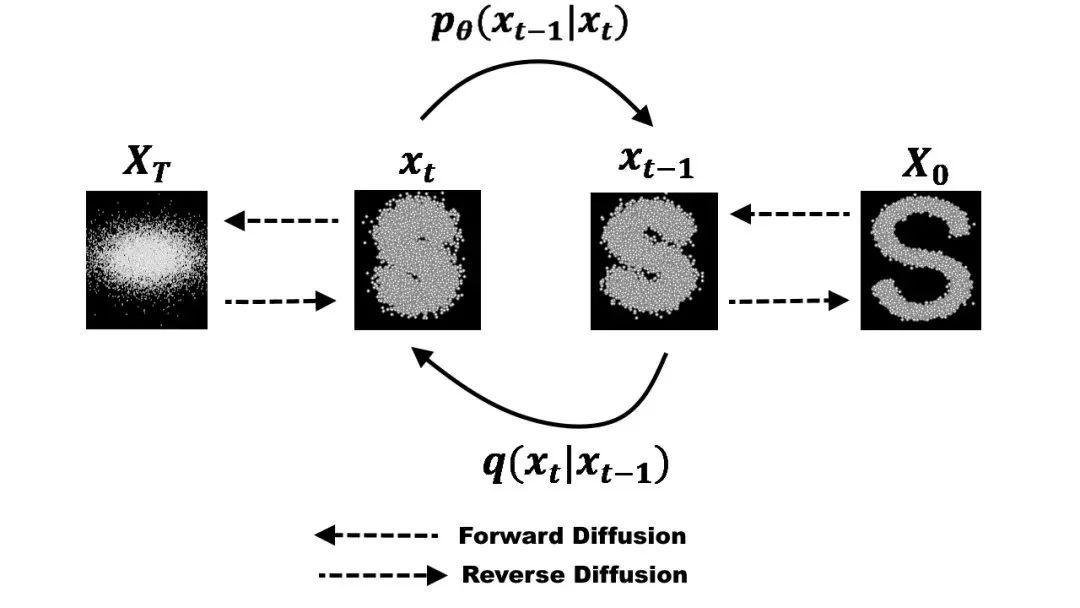

扩散模型分为两个过程。如下图所示,右边是一张正常的图片。从右到左的 Forward Diffusion 是一个逐步地将正态分布的噪声叠加到图片上的过程,最终得到一张看起来完全是噪声的图片。可以不严谨地想象成往一块牛排上不断撒椒盐,直到它看起来完全被椒盐覆盖,看不清原来的纹路。

而最新的 Stable Diffusion 模型,则是在此基础上结合了一个训练好的 VAE 模型。VAE 模型可以对任意图片进行压缩再解压,将图片使用 VAE 的编码器压缩后能得到比原图小很多的特征编码,再基于特征编码训练扩散模型,最终生成的特征编码再使用 VAE 的解码器还原回原始尺寸的大图,这就是 Stable Diffision 的做法。这一改进大大减少了图像生成的时长和占用的 GPU 资源,使得落地成为可能。

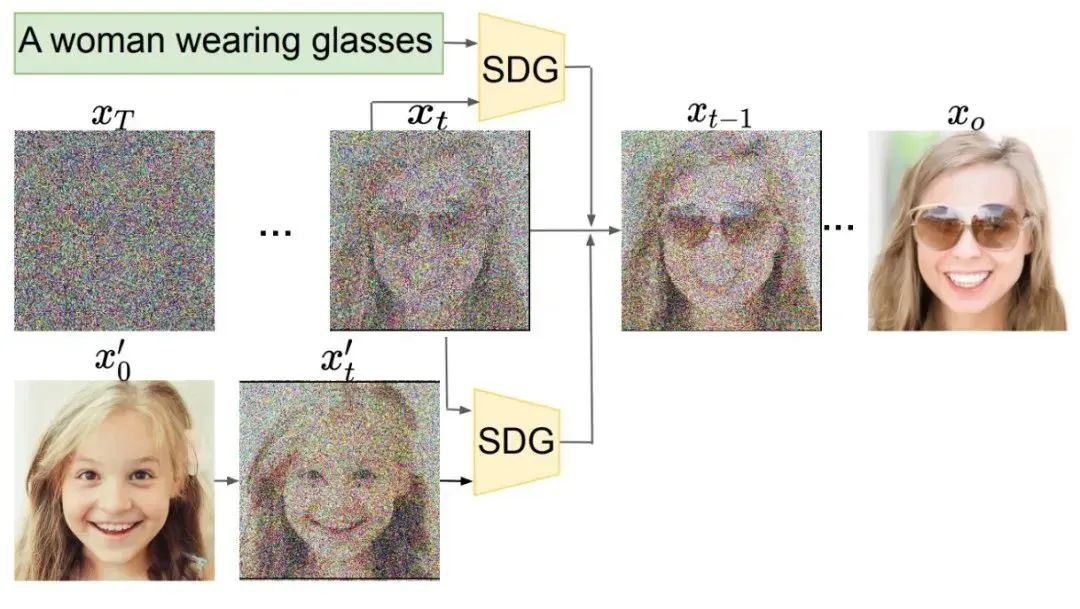

2.2. 生成结果控制

为了能够使用文字控制模型生成的内容,Stable Diffusion 模型使用了预训练的 CLIP 模型来引导生成结果。CLIP 模型使用了大量的文字和图片对训练,能够衡量任意图片和文本之间的相关性,即 CLIP-score。在前向生成图片的过程中,模型除了要去噪以外,还需要让去噪后的图片和引导词的 CLIP-score 尽量大。这样在不断生成过程中,输出结果就会越来越接近我们给定的文字描述。

3 我们的技术方案

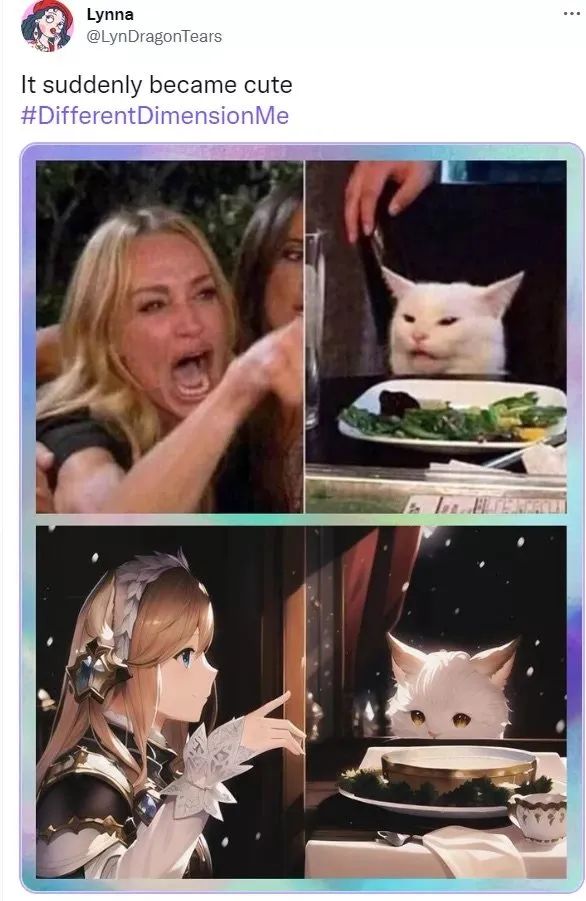

Stable Diffusion 技术在 AI 画画尤其是二次元领域中展现出非常高的观赏性和娱乐性,各家纷纷推出基于 Stable Diffusion 的 AI 画画平台,如 draft.art、意间 AI 等。但当时现有的平台在使用上非常不便捷,如果直接生成,大概率生成的质量不会很高,还容易遇到翻车现场:

我们针对这些痛点进行了优化改造,用户只需要上传一张图片,即可得到好看稳定的生成效果,降低了使用门槛的同时也保证了生成质量。

在技术上,我们主要进行了以下几点优化:

- 准确的内容生成:通过自研 diffusion 模型对生成语义进行强化,并辅助图片内容分析提升生成内容对应性;

- 更快的生成速度:利用超分模型减少 difussion 模型的生成分辨率,并针对图像 inference 过程进行加速,提升生成速度,节约 GPU 资源;

- 多样的风格选择:针对不同的场景设计了丰富且美观的风格化效果。

另外我们在设计玩法时简化了用户的使用流程,让用户使用门槛更低,体验更好,通过口碑积累达到了峰值 1000%的二次传播率。

3.1. 准确的内容生成

之前的一些 AI 画画平台,如意间 AI,draft art 等,除了上传图片,还需要使用一系列的描述主体和风格的引导词(prompt),有时候还需要调整不同参数,来得到一个理想的结果。

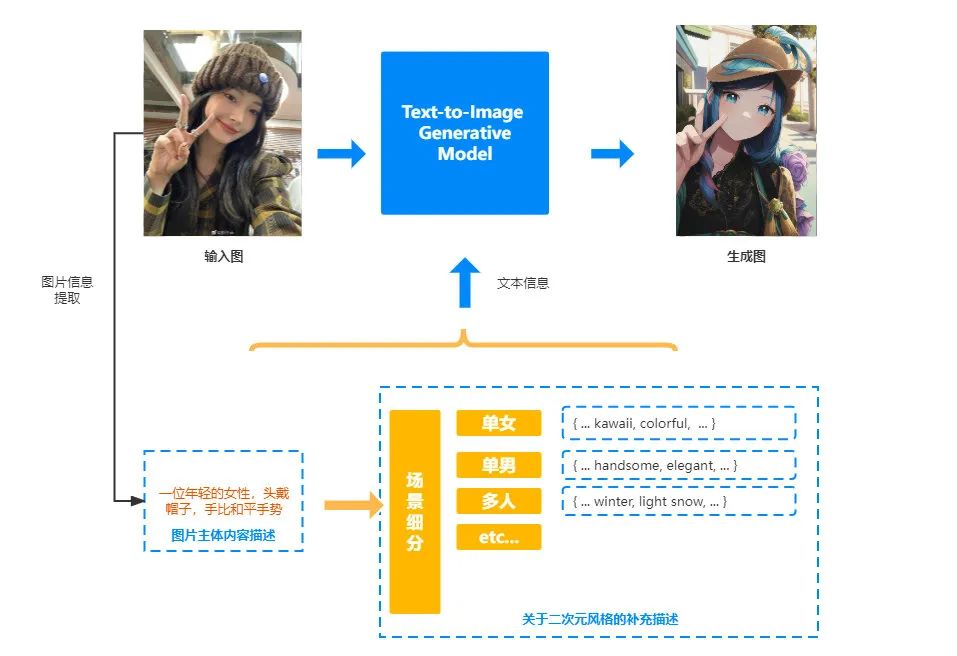

为了降低用户的使用门槛,我们对 pipeline 进行了改进:

内容描述:为了得到图片的内容描述,我们对输入图中的信息进行人物性别、年龄、姿势等属性的检测,得到最终尽可能准确详尽的内容描述词。

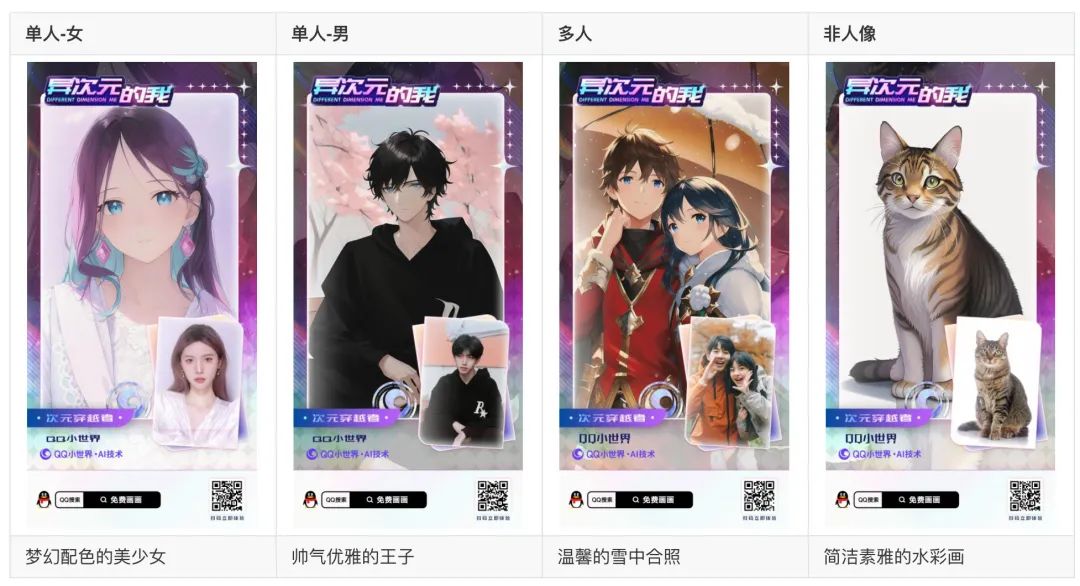

风格描述:为了让结果更接近二次元,我们为各种不同场景设计了非常鲜明的二次元风格。根据第一步对图片内容进行分析后,进一步细分为单人男性、单人女性、多人等不同场景。

结合内容描述和风格描述,我们通过对原图的分析得到最终完整的提示词输入网络,从而能够稳定生成画面精致、风格突出的结果。既保证了生成内容和原图的对应性,又增添了很多“异次元”要素,让用户更有穿越到二次元的感觉,同时也保证了较高的生成质量。

另一方面,我们的自研 diffusion 模型针对语义理解进行了强化,能够更准确理解和生成图片的主体内容,在语义信息理解和图像生成质量上均有明显提升。

和近期推出相似玩法的竞品对比,我们在内容准确度上会更好,风格也更加二次元化,更美观:

3.2. 更快的生成速度

原始的 Stable Diffusion 由于需要通过多次迭代生成图片,在默认配置 A100 机器上生成一张 720p 的图像耗时约 12s。如果需要通过提升分辨率和增大迭代步数来提升效果,耗时更是需要多达一分钟。我们针对自研模型采取了一系列的模型压缩和工程加速的方案,最终一张图片的生成速度是 1.6s,提升了 7 倍。

3.3. 多样的风格选择

我们提供了各种丰富且贴近二次元的画风供不同场景使用:

今后还会有更多风格正在陆续推出,敬请期待!

3.4. 简易的使用流程

当前的活动链路如下:

用户不需要输入复杂的风格和内容描述,只需要一张图片即可直接参与活动。一方面引导用户保存带有活动二维码的结果图片,帮助活动的二次传播;另一方面同时生成精美的展示视频,鼓励用户将其发布到小世界,带动小世界的发布量。

本次活动受到用户的积极参与,小世界#异次元的我#话题内,投稿突破百万,浏览量上亿;同时在 QQ 外部的其他平台如微博、小红书、推特等,也有非常多用户参与。

4 结语

总结这次活动爆火背后的核心原因:

- 提供了稳定且美观的生成效果;

- 简化 AI 画画的生成过程,降低用户使用门槛;

- 玩法的趣味性强,用户参与性高,二次传播率高导致破圈

根据目前用户反馈,用户对新兴玩法的参与度和兴趣都很高。因此,我们之后还会不断挖掘和探索更加有趣的新玩法,以帮助用户第一时间享受到新技术的乐趣,协助用户创作出有趣的内容。

这次项目得以迅速落地,一方面归功于算法团队在算法研发上已有积累,能够提供足够美观稳定的效果,另一方面小世界早在五月开始,每个月都会推出 AICG 相关的活动,在这方面有丰富的经验,使得运营/产品/算法/后台能快速联动。

QQ 影像中心一直在持续投入自研基础大模型的研发,目前的语义表达和美学效果明显优于 Stable Diffusion,例如对于”一只戴着牛仔帽和黑色皮夹克的浣熊在后院的窗户后面, 窗户上有雨滴”这样复杂的语句,我们和 Stable Diffusion 的生成结果对比: