领先99%小白的Sora关键信息!

阿里妹导读

Sora是一个以视频生成为核心的多能力模型,本文简单介绍了什么是Sora,主要从Sora有多强、Sora技术突破以及复刻难度、意义和启发三个方向出发展开讨论。

- 1、Sora是一个以视频生成为核心的多能力模型,相当于是openAI集齐七龙珠之后的融合产物,是目前最强的模型;

- 2、炸裂点:准商业级应用:1)文/图生视频;2)视频生成视频(带货植入/二(xi)创 (gao);3)1分钟超长超高质量,开箱即用;4)视频裂变,自主生成多个视角;

- 3、技术路线启发:石破天惊的地方在工程化上和架构突破。核心技术latent、transform、diffsion、recaption技术点上都不新,开源项目如Google video多模态、李飞飞早期论文都提到了很多本次Sora的技术路线。sora成功再一次证明:Scaling Law模型规模的增大对视频生成质量的提升具有明确意义;数据工程很重要、工程化能力是很大的技术壁垒、LLM 大语言模型仍然是核心,多模态(文生图、图生文)都需要文本语义去牵引和约束生成的内容;

- 4、个人意义:模型和应用会逐渐分离,1万亿的AI Infra市场很大很大,非头部公司更要选好路径坚定投入;对普通人来说懂工作流+会用工具=核心竞争力;用好提示词的关键是有自己的知识体系;会做内容的人能力*40倍;

contents

- Sora有多强

- Sora技术突破以及复刻难度

- 意义和启发

Sora有多强?

参考Sora与Runway Gen2、Pika等能力差异对比表可见,不论是基本的视频生成能力(时长、长宽比),还是更强的视频连续性、真实世界模拟等,OpenAI Sora都有无可比拟的优势。其中,视频清晰度,OpenAI Sora默认是1080P,而且其它平台大多数默认的清晰度也都是1080P以下,只是在经过upscale等操作之后可以达到更清晰的水平。60s的时长已达开箱即用的商业价值。

上述视频生成能力项中,视频连接、数字世界模拟、影响世界状态(世界交互)、运动相机模拟等都是此前视频平台或者工具中不具备的。

另外值得一提的是,OpenAI Sora模型还可以直接生成图片,也就是说,它是一个以视频生成为核心的多能力模型。

技术突破点

通过UE5、Unity、Nerf等大量生成了合成数据作为训练集

合成数据的大量应用是通向AGI的关键一步,据说本次Sora的能力大突破,其中之一就是可能通过UE5、Unity、Nerf等大量生成了合成数据作为训练集。

数据驱动的物理引擎

Sora能模拟真实或幻想的世界,学习复杂的渲染、物理规则和长期推理。它甚至可能用虚幻引擎5(UE5是一个顶级游戏引擎)进行大量训练:

- 三维一致性 Sora可以生成具有动态摄像机移动的视频。随着摄像机的移动和旋转,人物和场景元素在三维空间中一致地移动。

- 长距离连贯性和物体持久性 对于视频生成系统来说,一个重大挑战一直是在采样长视频时保持时间上的连续性。Sora通常能够有效地模拟短距离和长距离依赖关系(不稳定)。例如,Sora可以在人物、动物和物体被遮挡或离开画面时仍然保持它们的存在。同样,它可以在单个样本中生成同一角色的多个镜头,贯穿视频始终保持他们的外观。

- 时间一致性(互动性) Sora可以模拟以简单方式影响世界状态的行为。例如,画家可以在画布上留下新的笔触,这些笔触随着时间的推移而持续存在,或者一个人可以吃汉堡并留下咬痕。

- 模拟数字世界 Sora还能够模拟人工过程,一个例子是视频游戏。Sora可以通过基本策略控制《Minecraft》中的玩家,同时以高保真度渲染世界及其动态。这些能力可以通过prompt包含“Minecraft”,零样本激活这样的能力。

有2个具体的实例可以体现上述能力:

提示词:“两艘海盗船在一杯咖啡内航行时互相战斗的逼真特写视频。”

- 模拟器实例化了两种精美的3D资产:具有不同装饰的海盗船。Sora 必须在其潜在空间中隐式地解决文本到 3D 的问题。

- 3D 对象在航行并避开彼此路径时始终保持动画效果。

- 咖啡的流体动力学,甚至是船舶周围形成的泡沫。流体模拟是计算机图形学的一个完整子领域,传统上需要非常复杂的算法和方程。

- 照片写实主义,几乎就像光线追踪渲染一样。

- 模拟器考虑到杯子与海洋相比尺寸较小,并应用移轴摄影来营造“微小”的氛围。

- 场景的语义在现实世界中并不存在,但引擎仍然实现了我们期望的正确物理规则。

自主创建多个视角的视频

复刻难点:物理引擎、世界模型难度就很大。

世界模型和物理引擎是虚拟现实(VR)和计算机图形学中的两个关键概念。世界模型是描述虚拟环境的框架,包括场景、对象、光照等元素,用于呈现虚拟世界的外观和感觉。物理引擎则是用于模拟和计算物体之间的物理运动和互动,如重力、碰撞、摩擦等。简而言之,世界模型是虚拟环境的静态描述,而物理引擎则负责模拟虚拟环境中物体的动态行为。它们共同作用于虚拟现实技术中,为用户提供沉浸式的体验。

世界模型要求更高,这包括对复杂场景和物理效果的处理能力、提高在新环境中的泛化能力、以及更好地利用先验知识进行实时推理、预测和决策等。虽然Sora已经能够生成较为准确的视频内容,但当场景中涉及到多个物体的交互或复杂的物理运动时,Sora可能会出现失误或偏差。其次Sora目前主要依赖于大量的训练数据来学习视频的生成规律,但这种方式可能限制了其在新环境中的泛化能力和实时决策能力。这也是目前Sora并非一个世界模型的原因 来源:gpt4问答结果

多个技术积累优势

从Sora模型的技术报告中,我们可以看到Sora模型的实现,是建立在OpenAI一系列坚实的历史技术工作的沉淀基础上的包括不限于视觉理解(Clip),Transformers模型和大模型的涌现(ChatGPT),Video Caption(DALL·E 3)

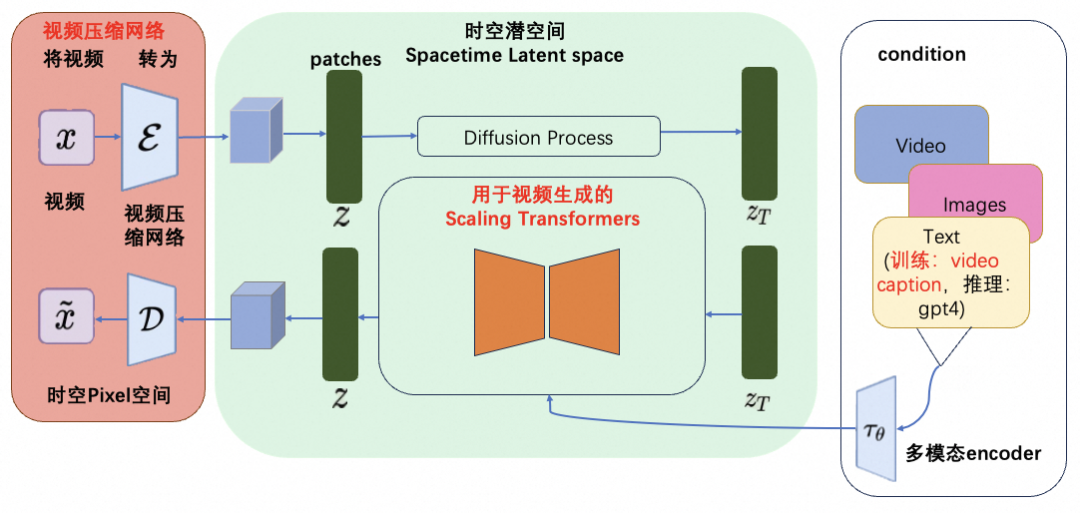

来源:ModelScope论坛文章,Sora技术图\[1\]

关键点1:视频压缩网络

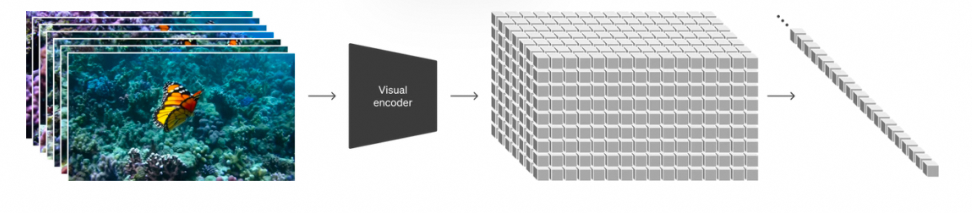

patches是从大语言模型中获得的灵感,大语言模型范式的成功部分得益于使用优雅统一各种文本模态(代码、数学和各种自然语言)的token。大语言模型拥有文本token,而Sora拥有视觉分块(patches)。

OpenAI在之前的Clip等工作中,充分实践了分块是视觉数据模型的一种有效表示(参考论文:An image is worth 16x16 words: Transformers for image recognition at scale.)这一技术路线。而视频压缩网络的工作就是将高维度的视频数据转换为patches,首先将视频压缩到一个低纬的latent space,然后分解为spacetime patches。

难点:视频压缩网络类比于latent diffusion model中的VAE,但是压缩率是多少,如何保证视频特征被更好地保留,还需要进一步的研究。tokenization:内容二维向量化

图解LLM训练和推理的秘密-1\[2\]

patches

图片来源:sora技术论文

关键点2:长视频的scaling transformer

给定输入的噪声块+文本prompt,它被训练来预测原始的“干净”分块。重要的是,Sora是一个Scaling Transformers。Transformers在大语言模型上展示了显著的扩展性,

难点:可能包括的难点有long context(长达1分钟的视频)的支持、复杂实体decoder一致性、对video condition,image condition,text condition的多模态支持等。

关键点3:Video recaption

视频摘要/视频字母生成属于多模态学习下的一个子任务,大体目标就是根据视频内容给出一句或多句文字描述。所生成的caption可用于后续的视频检索等等,也可以直接帮助智能体或者有视觉障碍的人理解现实情况。通过这样的高质量的训练数据,保障了文本(prompt)和视频数据之间高度的align。Sora还使用 DALL·E 3 的recaption技巧,即为视觉训练数据生成高度描述性的caption,这让Sora能够更忠实地遵循生成视频中用户的文本指令,而且会支持长文本,这个应该是OpenAI独有的优势。在生成阶段,Sora会基于OpenAI的GPT模型对于用户的prompt进行改写,生成高质量且具备很好描述性的高质量prompt,再送到视频生成模型完成生成工作。> caption训练数据都匮乏:一方面,图像常规的文本描述往往过于简单(比如COCO数据集),它们大部分只描述图像中的主体而忽略图像中其它的很多信息,比如背景,物体的位置和数量,图像中的文字等。另外一方面,目前训练文生图的图像文本对数据集(比如LAION数据集)都是从网页上爬取的,图像的文本描述其实就是alt-text,但是这种文本描述很多是一些不太相关的东西,比如广告。

技术突破:训练一个image captioner来合成图像的caption,合成caption与原始caption的混合比例高达95%:5%;但是不过采用95%的合成长caption来训练,得到的模型也会“过拟合”到长caption上,如果采用常规的短caption来生成图像,效果可能就会变差。为了解决这个问题,OpenAI采用GPT-4来“upsample”用户的caption,下面展示了如何用GPT-4来进行这个优化,不论用户输入什么样的caption,经过GPT-4优化后就得到了长caption:DALL-E 3技术报告阅读笔记[3]

难点:这项技术并不新,难的是积累,即便是合成数据也需要大量的专业标注和评测。“大”模型,“高”算力,“海量”数据意义和启发

还有很多生成bug,继续抽卡、炼丹

- 物理交互逻辑错误:Sora有时会创造出物理上不合理的动作;Sora模型在模拟基本物理交互,如玻璃破碎等方面,不够精确。这可能是因为模型在训练数据中缺乏足够的这类物理事件的示例,或者模型无法充分学习和理解这些复杂物理过程的底层原理

- 对象状态变化的不正确:在模拟如吃食物这类涉及对象状态显著变化的交互时,Sora可能无法始终正确反映出变化。这表明模型可能在理解和预测对象状态变化的动态过程方面存在局限。

- 复杂场景精确性丢失:模拟多个对象和多个角色之间的复杂互动会出现超现实结果; 长时视频样本的不连贯性:在生成长时间的视频样本时,Sora可能会产生不连贯的情节或细节,这可能是由于模型难以在长时间跨度内保持上下文的一致性 ; 对象的突然出现:视频中可能会出现对象的无缘无故出现,这表明模型在空间和时间连续性的理解上还有待提高

什么时候能用上

- 使用魔法访问ChatGPT官网

- 开plus会员,等待开放使用资格

- Sora目前对红队成员开放,用于评估可能的风和危害(红队=专门测试系统漏洞的安全专员;

- Sora目前对创作者开放。用于优化模型的创作能力(视觉艺术家、设计师和电影制作人)普通会员还要继续等下一个阶段的内测,到全民可用估计要等,这也是为啥sam开始要7w亿美金造芯计划,这对算力的消耗确实很大;

能用大概多贵

SORA 模型参数量预计 <10B,模型参数量不会像 LLM 需要千卡/万卡大规模 AI 集群训练(~百卡);OpenAI 尚未公布 SORA 商业化时间,视频生成距离成熟还有时间距离(< 半年);技术上输入内容控制一致性等问题仍需解决,推理算力全面爆发仍然有时间差(> 半年);目前推理算力比 SD、SDXL 要大2/3个量级,需要结合 AI 训练集群或者 AI 推理集群。

参考GPT4V计算Token 的方式:2048*4096 image detail = 1105个Token 以1080P视频为例,30FPS的视频,就是1920×1080(像素)*3(RGB通道)*30(FPS)*60(时长)。可以计算1分钟长度视频价格。

写好prompt依旧很重要,关键还是有知识积累,能转化成框架、工作流

Sora官方视频截图

官方提示词:逼真的特写视频,展示两艘海盗船在一杯咖啡内航行时互相争斗的情况。

优化:

- Context:一杯咖啡的微型世界。

- Persona:两艘海盗船。

- Goal:展示海盗船在咖啡杯内的逼真争斗场景。

- Constraints:视频应突出海盗船的细节和动态,以及咖啡的纹理作为背景。

- Steps: 设定场景为充满咖啡的杯子,咖啡表面作为海洋。 描述海盗船:两艘细致的海盗船在咖啡“海洋”中航行和争斗。强调特写镜头:使用特写镜头视角捕捉海盗船的动态和咖啡的纹理。展现争斗细节:海盗船的交火,船上海盗的动作。

- Examples: 相似效果链接

Template:cssCopy Code

- [场景描述]在一个充满酒的杯子中,咖啡表面波动着仿佛一个微型的海洋。

- [人物描述]两艘装备精良的海盗船在这杯咖啡的海洋中航行,互相展开烈的争斗。

- [目标]透过逼真的特写镜头展现海盗船在咖啡杯子内互相争斗的壮观场景。

- [约束条件]注意捕捉海盗船的细节和动态,以及咖啡作为背景的纹理和波动。

Sora官方视频截图

官方提示词:一位时尚女性走在充满温暖霓虹灯和动画城市标牌的东京街道上。她穿着黑色皮夹克红色长裙,拎黑色钱包。她戴着太阳墨镜涂着红色囗红。她走路自信又随意。街道潮湿且反光,在影色灯光的照射下形成镜面效果。许多行人走来走去。

优化:

- Context: 一条充满活力的东京街道在夜晚灯火通明,霓虹灯和动画广告牌交织成一道道流光溢彩的光带。细雨过后的街道湿润且反光,在多彩的灯光照射下形成迷人的镜面效果。许多行人在这灯光闪烁的夜色中来往匆匆。

- Persona: 一位时尚女性身着黑色皮夹克,搭配鲜艳的红色长裙和黑色靴子,手拎一只黑色钱包。她戴着太阳镜,嘴唇涂抹着红色口红,走路自信又洒脱。

- Goal: 展示这位时尚女性在霓虹灯光点缀的东京夜晚中自信与风采。

- Constraints: 视觉应该突出夜晚的霓虹灯光效果,反映出潮湿街道的反光效果,以及人物的时尚装扮,强调人物的自信步伐和随性的走路风格。

- Steps::

- 设定场景为东京的一个夜晚街道,由霓虹灯照明。

- 描述人物:一位穿着黑色皮夹克、红色长裙和黑色靴子的时尚女性,手拿黑色钱包,戴着太阳镜并涂有红色口红。

- 强调人物的自信步伐和随性的走路风格。

- 描述环境:潮湿的街道在灯光下反射,周围有行人。

示例: 提供一段描述或者图片,展示类似场景的效果。

Template:cssCopy Code:

- [场景描述] 在一个充满活力的街道上,霓虹灯的彩光波动着,仿佛一个微型的夜晚海洋。

- [人物描述] 一位时尚女性在这条街道上自信地行走,她的黑夹克和红裙在灯光下显得格外抢眼。

- [目标] 通过鲜明的场景描述,展现时尚女性在霓虹灯光下的自信与风采。

- [约束条件]注重捕捉人物装扮的细节和动态,以及潮湿街道作为背景的纹理和反光。对谁来说是神器

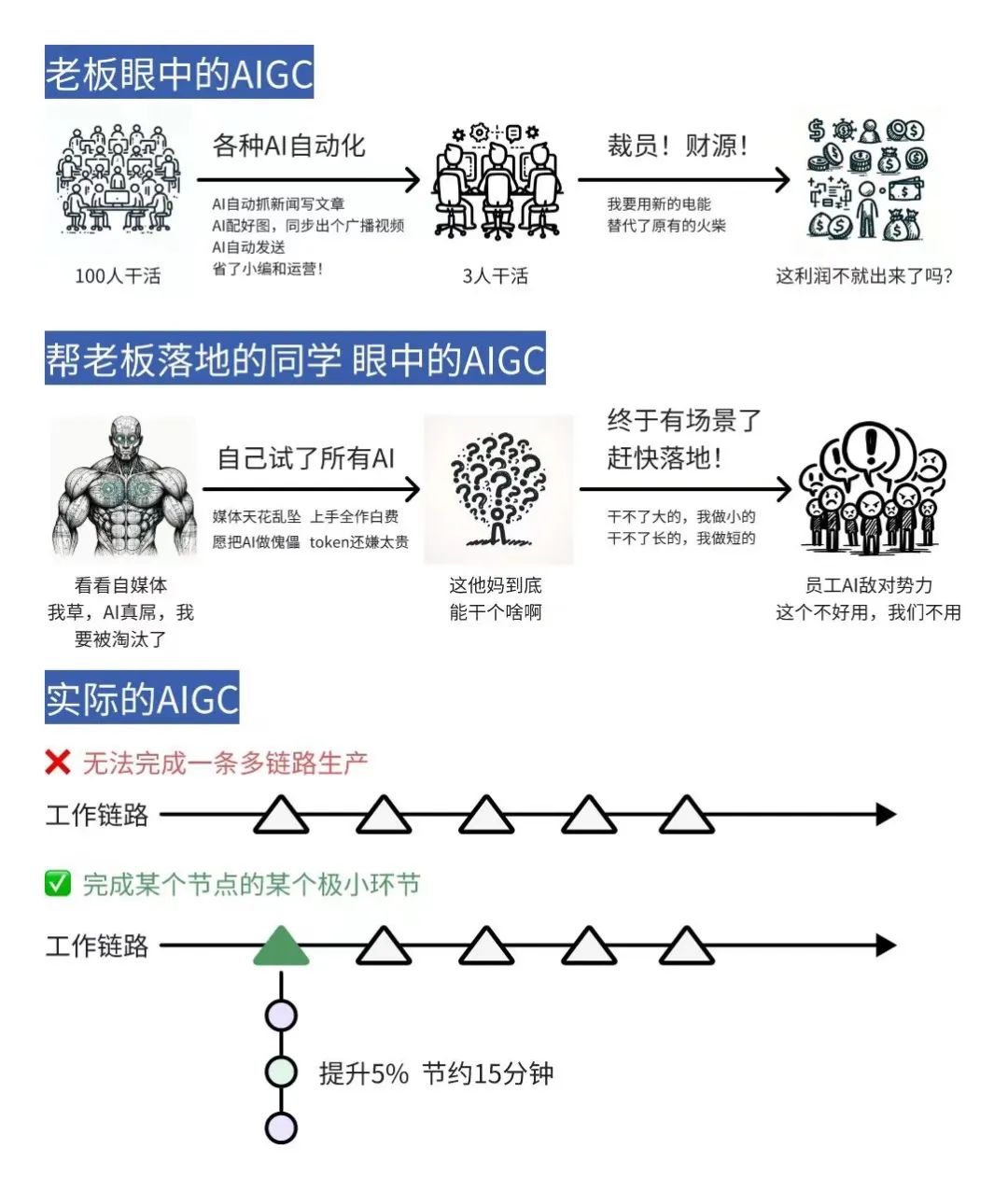

利好内容工作者:比如影视工作者、视频创作者、视频广告行业尤其是投手(投流素材的工业化+定制化,根据SEO需求文生视频)普通人:闲下来就能玩的?没有想到,内容创作本身尤其是到可变现的水平还是有较高的门槛。所以这个对普通人来说是一个AGI时代更普适的问题。不可替代的竞争力是什么?灵敏的嗅觉+对各类工具的活用+自身知识体系;创新只可能发生在自己真正的兴趣领域,找到你的热爱并持续玩终有一天可以真正享受科技实现创作者经济自由。

对于AI 从业人员

After all,in the AI industry, tomorrow is another year...

1、既要好高骛远更要脚踏实地:据投资人介绍,整体AI infra市场建设起来需要1W亿的资金,市场盘子足够大。同时openAI不断打破天花版也给明了技术路线,机会依旧很多。先做到5%~10%提效(效率,效果)再谈星辰大海;一切的基础还是先拿个入场券哪怕只是参观券。开源:闭源模型不是完美的,优化弱点就能成功。开源的LCMvsLDM就是个例子。LDM 20 步 扩 散 生 成 一 张 图;LCM 一 步生成一张图,有巨大的效益空间。应用:模型和应用市场逐渐分离,成熟用户平台、做infra中间件、数据工程等也是核心竞争力

2、如何解决冷启动的策略经验沉淀形成数据飞轮是任何AI类业务成败的关键。比如强大集成、专业顶尖的标注投入(比如在合成数据、AI评测的势头下,openAI很多标注评测工作都是科研人员)dirty work需要战略定力。

参考链接:

- [1]https://www.modelscope.cn/headlines/article/346

- [2]https://zhuanlan.zhihu.com/p/671203641

- [3]https://zhuanlan.zhihu.com/p/662745543