Stable Diffusion你需要知道的算法原理(通俗版)

前言

本篇文章旨在以更加通俗易懂的给大家讲解Stable Diffusion生成原理,通过本文,你将掌握以下知识:

01 Stable Diffusion原理介绍

- 什么是扩散(Diffusion)?

- 扩散(Diffusion)是怎么能被稳定(Stable)控制的?(以文生图为例)

- CLIP:我们输入的文字prompt是如何起作用的?

- UNET:扩散模型的工作原理

- 理解VAE的编解码过程

02 模型训练相关原理

- 机器是如何认识图片的?

- 模型是如何被训练的?

03 大模型微调技术

- 为什么要进行大模型微调?

- 大模型微调需要解决的两个问题

- 常见的大模型微调技术及其原理(Dreambooth/LoRA/Embedding/ Hypernetwork)

01 Stable Diffusion原理介绍

1 什么是扩散(Diffusion)?

首先,大家要明确(Stable Diffusion)是一个算法,我们说的Stable Difuusion web UI是基于这个算法的一个工具。

我们不妨先来学习一下英语:Stable Diffusion中的Stable是稳定的(adj.),Diffusion是扩散(n.),所以Stable Diffusion的简单理解就是一种稳定的扩散的算法。

在图像领域中,扩散算法是通过一定规则去噪(反向扩散)或加噪(正向扩散)的过程。如下图演示的就是以prompt为**a red flower**做扩散的过程,从最开始的灰色噪点块、逐渐去噪到最终的清晰的过程:

2 扩散(Diffusion)是怎么能被稳定(Stable)控制的?

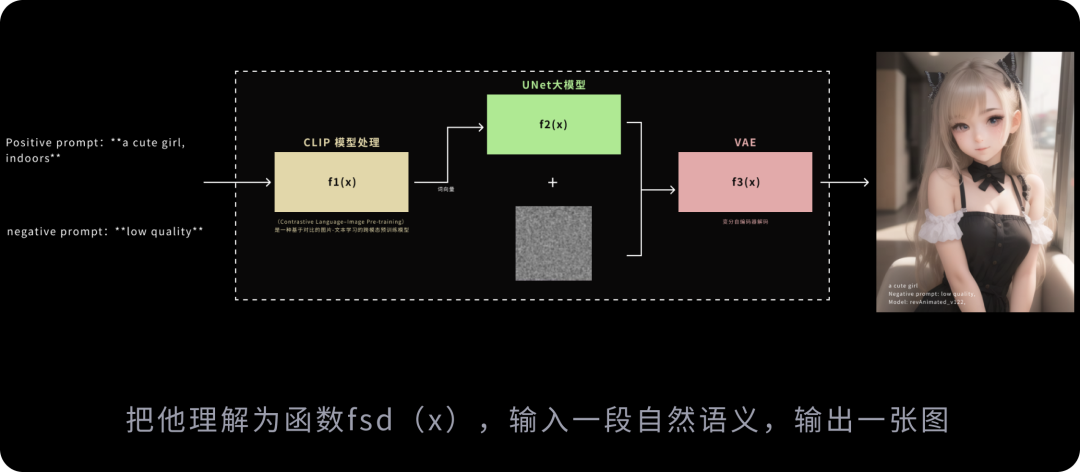

我们以文生图为例,给大家看一下Stable Diffusion的原理:

这里的过程,大家可以把它抽象理解为一个大函数Fsd(prompt),即:我们输入一段自然语义prompt,经过一系列函数运算和变化,最终输出一张图的过程。

3 CLIP:我们输入的文字prompt是如何起作用的?

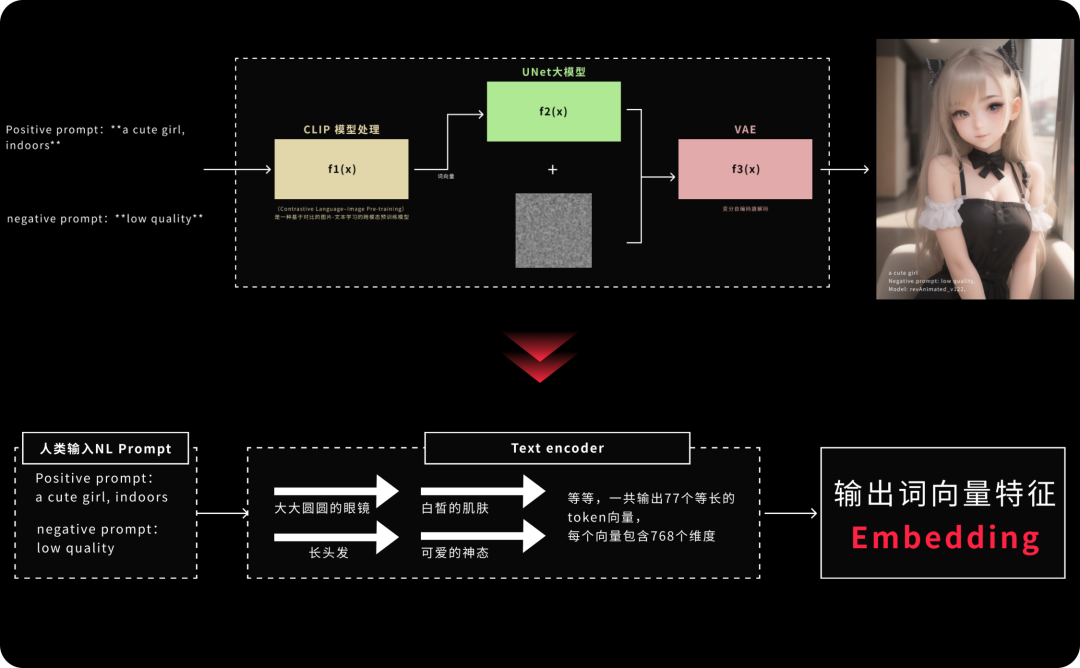

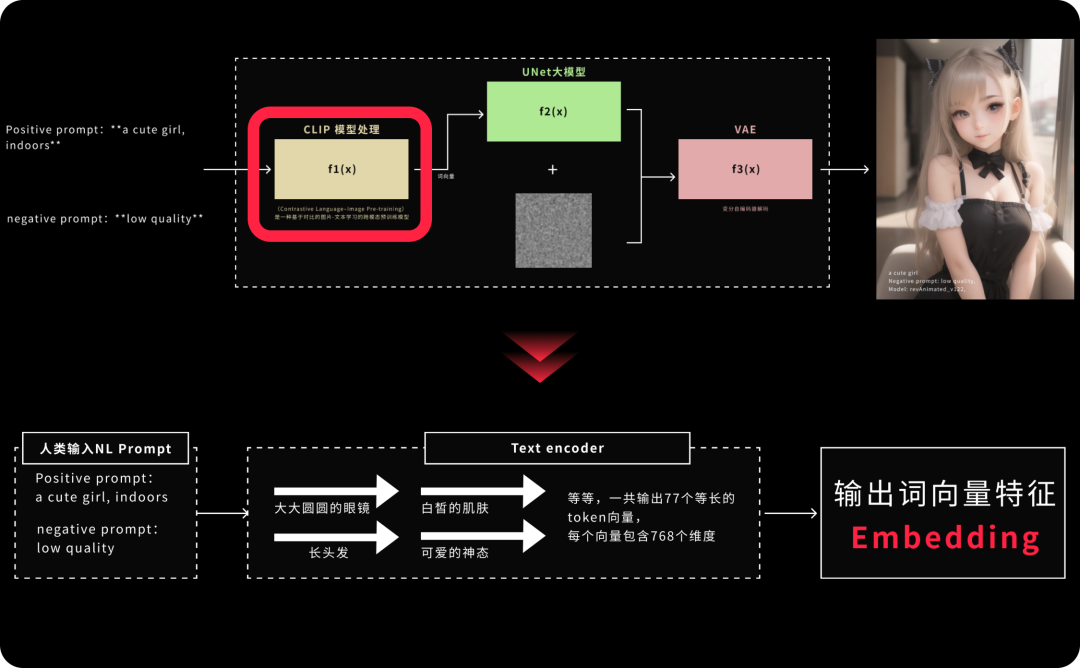

我们先来看第一个部分,我们输入了一段咒语,这段咒语是如何起作用的?让我们咒语起作用的是一段叫做CLIP的算法,CLIP是Text Encoder算法的一种,Text Encoder大家从字面意思也能够理解,是把文字转化为代码的一种算法,他的主要功能是把自然语义prompt转变为词特性向量(Embedding)。

如下图所示,我们举个例子,比如我们输入了一个prompt:**可爱的女孩**,CLIP算法作自然语义处理的时候会根据之前被程序员调教的经验,大概感知到可爱的女孩可能具有哪些特征?比如他们可能有”大大圆圆的眼睛“,可能有”白皙的肌肤“,可能有”可爱的神态“等等,然后这些可能得特征被转化为77个等长的token词向量(每个向量包含768个维度),这就是我们说的Embedding。

那么接下来我们来讲一下SD里最重要的UNET算法。

4 UNET:扩散模型的工作原理

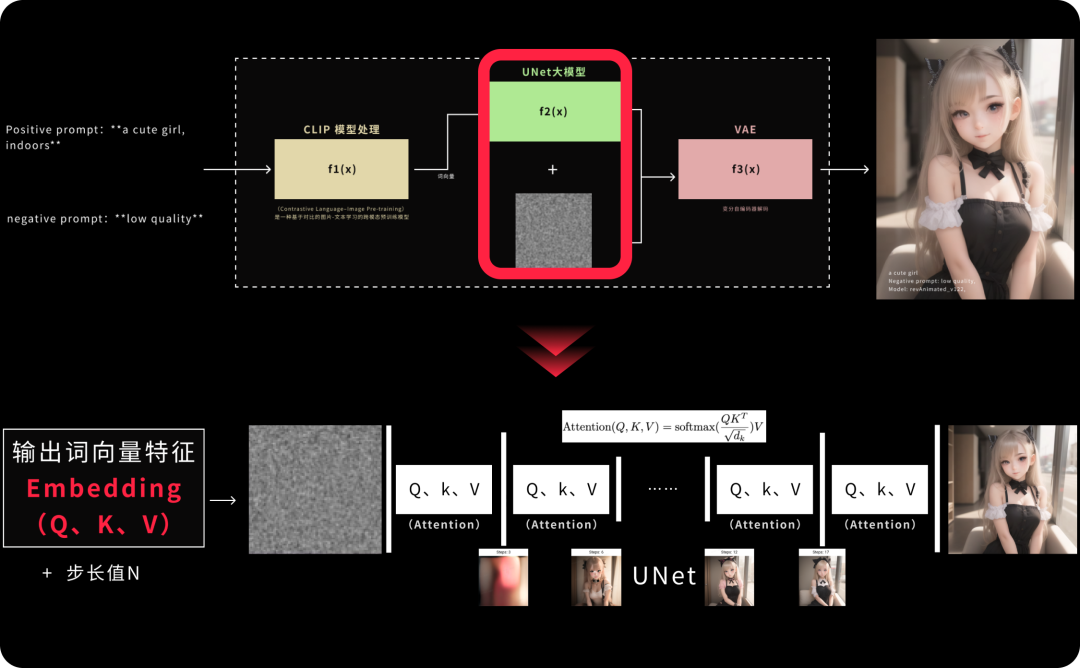

UNET他是一种根据词向量的扩散算法,他的工作原理如下图所示,在上面说到的Clip算法会根据我们输入的prompt输出对应机器能识别的词向量(Embedding),这个Embedding大家也只需要粗浅理解为他是一个函数,包含(Q、K、V)三个参数就好了。

这三个参数会根据我们输入的对应扩散步长,作用于UNET去噪算法的每一步,比如下图中,我设置了去噪步长为20步,大家能看到这张图逐渐扩散生成的效果。

这里需要注意的是,UNET去噪的时候,原理比上图描述的复杂很多,它其实并不是一步一步去噪就能得到对应效果的,如果仅仅是一步一步的去噪,效果往往很差,并不能精确得到描述文本的图片。

所以在这里我会稍微讲得深入一些,介绍一下Classifier Free Guidance引导方法:

为了保证我们的prompt最终的精确性,在UNET分步去噪的时候,比如我设置的去噪步长为20,他会在每一步都生成一个有prompt特征引导的图和一个没有prompt特征引导的图,然后把两者相减,就得到了每一个去噪步骤中单纯由文字引导的特征信号,然后将这个特征信号大很多倍,这就加强了文本引导。

同时,在第N+1步去噪结束后,它还会用第N+1步去噪的信息特征减去第N部的特征,然后继续方法很多倍,这样保证prompt在每一步都能有足够权重比参与运算。

上面那一段大家看不懂也没关系,用通俗的大白话来说,就是这个方法加强了prompt的权重。这个方法在Stable Diffusion web UI中被直译为提示词相关性,是一个常用参数,他的数值决定了生成的图与提示词的相关程度。

说完了文生图,我们大概也说一下图生图,咱们在使用Stable Diffusion web UI的时候用图生图的功能,往往是给一张图,然后再输入一段prompt,比如我们还是设置扩散步数N=20,这时候,它的原理是先把我们提供的图进行逐步加噪,逐步提取图片信息,使它变成一张完全的噪点图,再让prompt起作用,结合上面的UNET算法逐步去噪,得到既有素材图片特征也有prompt特征的最终效果图。

5 理解VAE的编解码过程

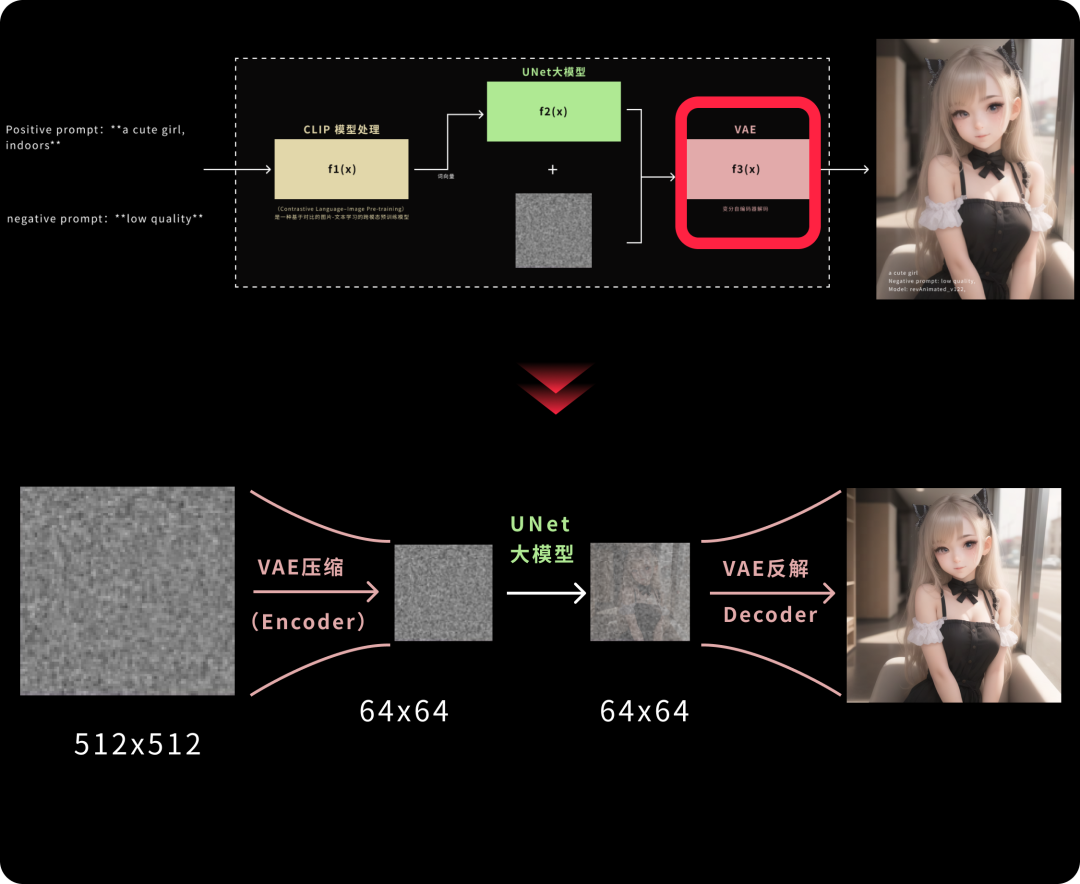

最后我们简单来理解一下CAE编解码的过程,VAE全称变分自编码器,这里大家不需要做太多理解,只需要知道他是一个先压缩后解压的算法就好了。

需要注意的是,我们上面写的UNET算法不是直接在图片上进行的,而是在”负空间“进行的,大家理解为在代码层面即可。VAE他的原理如下图所示,假如我们要生成的图是512x512的,VAE算法在一开始的时候,会把它压缩到八分之一,变成64x64,然后走UNET算法的时候,会把图形数据带在噪点图中,这个过程叫Encoder,然后再走完UNET算法后,我们得到了一个带有所有图片特征的噪点图,此时VAE再进行Decoder过程,把这张图解析并放大成512x512,知道到这里即可,不要深究。

讲到这里,其实SD的原理就已经讲完了,还好吧?其实也没那么难对吧?接下来我们要讲一下模型训练,先来看看模型是如何被训练出来的。

模型训练相关原理

1 机器是如何认识图片的?

首先,我们先来看看机器是如何认识图片的。相信大家都听说过,最初计算机视觉训练认识物体的时候,采用的是成对训练的方法,通过“图”+“对应描述”成对训练。运用图像识别、自然语义处理与卷积神经网络等一系列技术让计算机能够识别这个图形。

如上图所示,我们不停的给计算机喂成千上亿张狗的图,然后告诉他,你看这是狗,这也是狗,这还是狗,然后机器会不断归纳狗的特征,重复学习亿遍后,它就认识狗了。

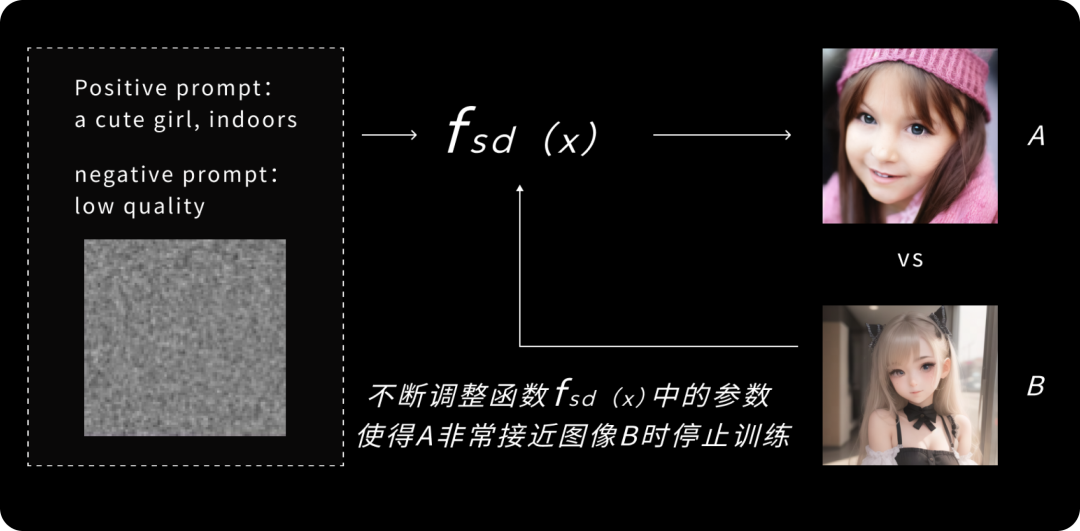

2.可供调用的模型是如何训练的?好了,假设这时候,机器已经能识别万物了,这时候机器由于学习的图片风格都不同,生成的图片有可能不满足我们的期望,举个例子:假设程序员经过十年的努力后,让机器正确认识了小女孩的特征,不会出现三个眼睛两个嘴巴。

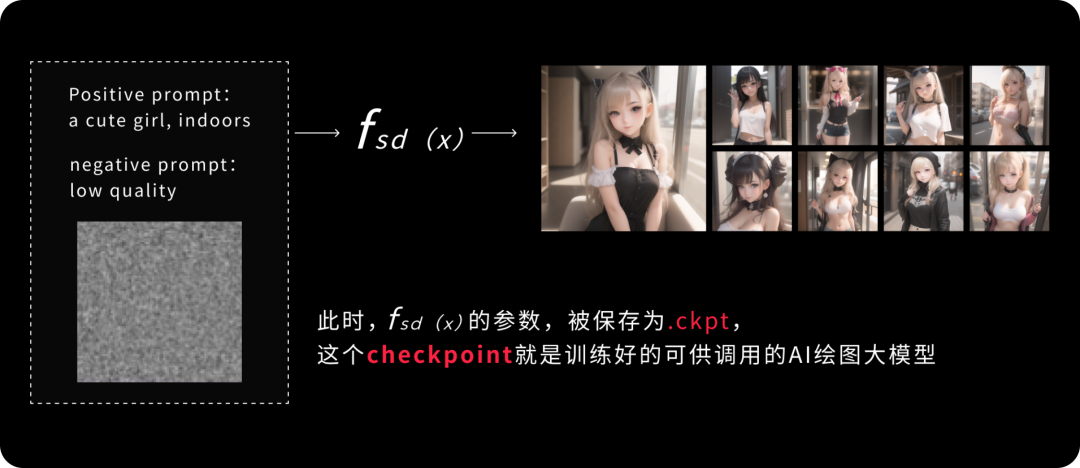

当我们输入一个**a cute girl**,生成的是图A,这时候假如A的风格与我们想要的完全不同,比如我们想要的是B这种,这时候程序员们就会不断调整函数中的各种算法和参数,使得产出的图形A无限接近图像B,然后停止训练,此时整个Fsd(x)函数的所有调整的参数,就被保存为一个.ckpt的文件,这个叫checkpoint的文件就是程序员训练好的可供调用的AI绘图大模型,他能保证我们每次生成的图偏向于某种特征集合。

整个过程如下图所示:

在我们去逛C站的过程中我们知道,Stable Diffusion可用模型有两类:

(1)safetensors:

safetensors 文件是用numpy 保存的,这意味着它们只包含张量数据,没有任何代码,加载.safetensors 文件更安全和快速。供调用的AI绘图大模型。

(2)ckpt:

ckpt 文件是用pickle 序列化的,这意味着它们可能包含恶意代码,如果你不信任模型来源,加载.ckpt 文件可能会危及你的安全。

这里大家简单了解,在C站下载模型的时候,优先下载.safetensors即可。

大模型微调技术

1 为什么要进行大模型微调?

刚刚上文我们介绍的Unet模型是SD中最重要的模型网络,内部包含上亿个参数,要训练这样一个超大的模型,大概需要15亿个图像文本,使用256张A100显卡跑15万个GPU小时,大概成本是60万美元,我们设计师不能像程序员那样动不动就调函数参数训练模型(主要是不会)。

那咋整?上面我们讲到UNET泛用性极强,泛用性极强就会带来风格化不足,可能无法满足特定风格的需要。所以我们往往会对UNET大模型进行微调,让他更符合我们的使用场景。接下来我将要给大家介绍模型微调技术。

也就是大家之后在Stable Diffusion里常用的训练方法,今天不会讲具体怎么训练,我只会给大家讲原理,讲明白了原理,大家在自学训练方法的时候则更容易理解。

2 大模型微调需要解决的两个问题

所有的大模型微调技术,都是基于要解决以下两个问题:

- (1)如何减少训练参数,提高训练效率和生成图像的质量;

- (2)如何解决模型泛化性差的问题;泛化性是模型对心数据的适应能力,他具体表现为过拟合和欠拟合两种,如下图所示:

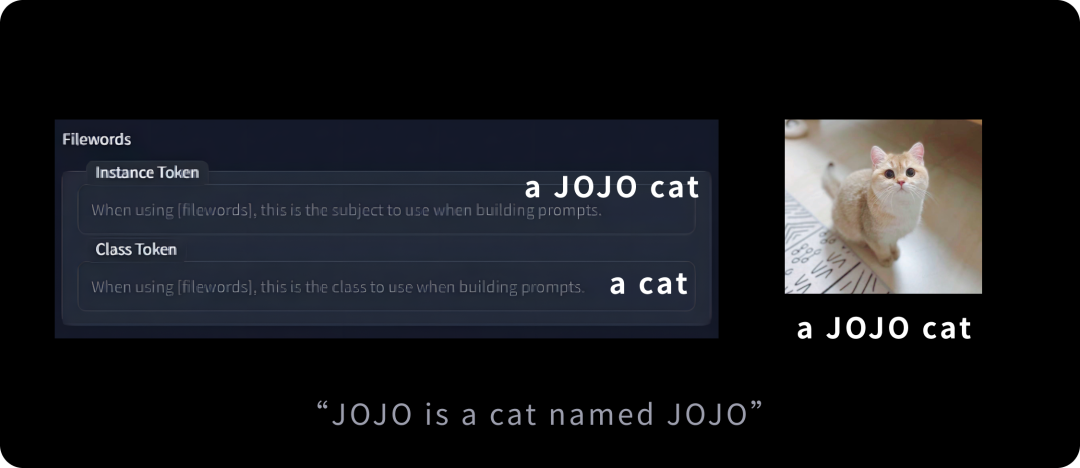

a.过拟合(Overfitting)是指微调模型对原始模型的语义理解程度发生了变化,整体训练出现语义漂移的现象:比如有一只猫,名字叫jojo,我拍了他的几十张照片,一直用a jojo cat这个名字来强化模型对这只猫的认知,等以后我输入a jojo cat的时候确实能出现想要的这只猫,但是我输入a cat的时候则出现的画面会很怪异,这就说明cat这个词被污染了,出现了过度拟合的现象。

b.欠拟合(Underfitting)是无法识别这一特征,比如它就完全识别不出jojo和cat的关系,这往往是训练样本量不足或者训练样本质量等因素导致,属于训练无效。

好,那么我们来看下常见的大模型微调技术都有哪些,以及他们是如何解决上面两个问题的。我们常见的大模型微调技术就是以下这四个:Dreambooth/LoRA/Embedding/Hypernetwork,这在我们后续学习Stable Diffusion过程中会经常用到,相信大家都已经或多或少了解一点了,接下来就带大家揭开他们神秘的面纱。

3 Dreambooth

我们先来看Dreambooth是怎么解决过拟合这个问题的:Dreambooth要求我们在训练过程中,“特征词+类别”和“类别”成对出现,解决过拟合的问题;比如之前提到的我如果想训练这只叫JOJO的猫的模型,又不能让它跟“猫”这个词过度拟合,我们可以采用的这样的输入方法。这样的话AI就能识别到:JOJO cat is a cat named JOJO。

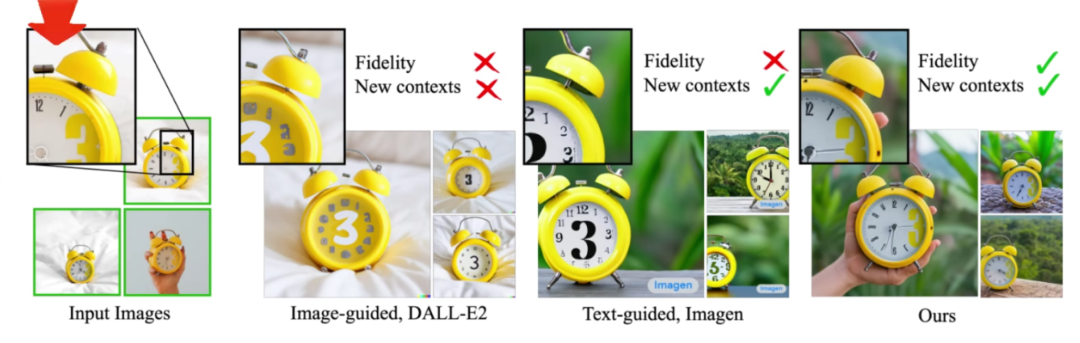

Dreambooth是google在2022年8月提出的一种新的图像算法,其方法可以完整的获得你想要的模型的视觉特征,它的提出既不是为了训练人物也不是为了训练画风,而是为了能在少量训练图像的基础上完美的还原细节特征。大家来看下图,是在当时微软研发大会上(如果我没记错的话)发布这个模型的时候对细节特征的描绘:

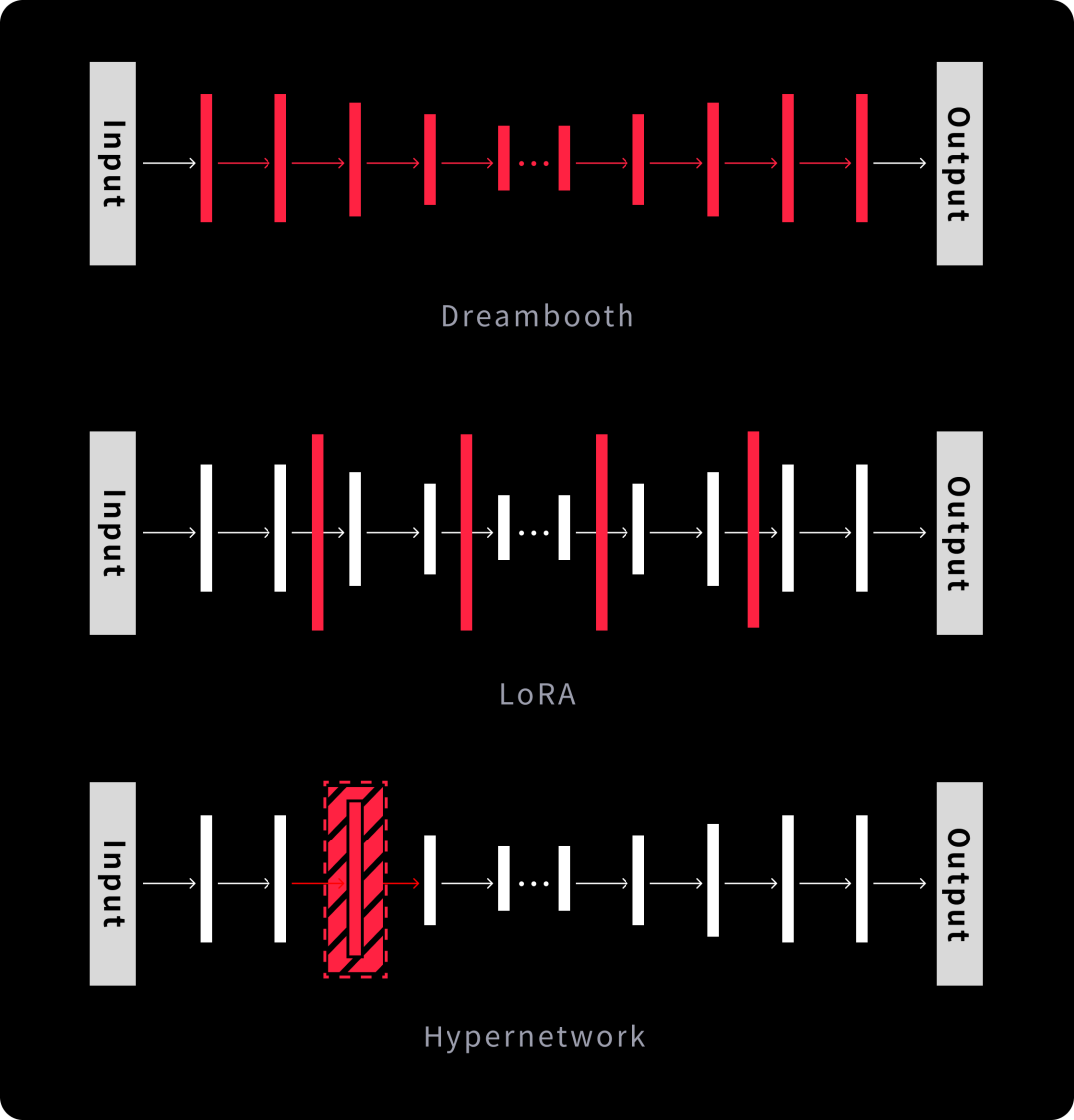

大家看看原图闹钟右侧有一个”黄色的3“,Dreambooth将他完整还原了,这说明使用Dreambooth确实可以完整的获得你想要的模型的视觉特征,所以当时发布的时候还是很牛的。Dreambooth虽然叫大模型微调技术,但是他调得一点都不微,他基本把UNET算法的每一层内部参数都调了一遍,如下图红色部分所示,所以他的优点和缺点都很明显。

Dreambooth优点是:可以将视觉特征完美融入;Dreambooth缺点是:需要调整UNet所有内部参数,训练时间长,模型体积大。

4 LoRA(大模型的低秩适配器)

讲完了Dreambooth之后我们来讲一下LoRA,相信大家都听过这个词了,一定对它非常感兴趣对不对?

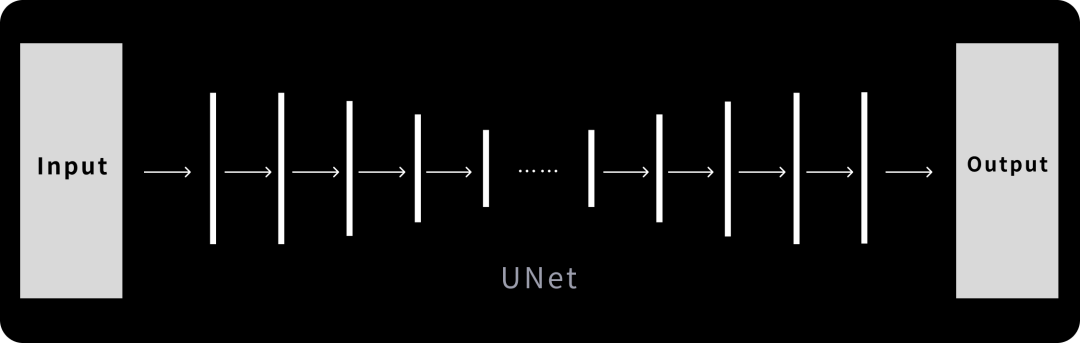

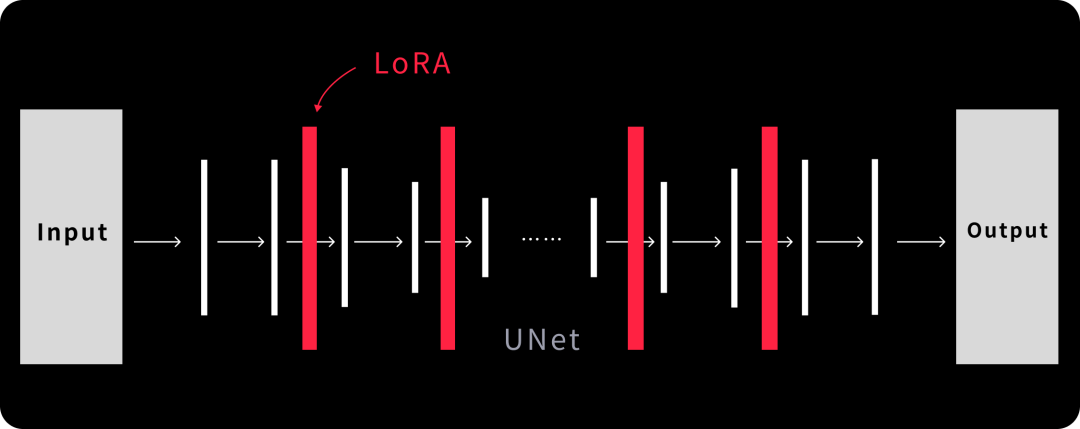

要讲清楚LoRA的原理,还是得回到之前的UNET算法,还记得上面这张图吗?

这是SD的核心算法UNET的工作原理,SD内部的UNET神经网络运算结构是由很多很多的计算层叠加组成的,它的内部的每一个计算层大家把他看成一个一个的小函数,前一个函数的输出等于后一个函数的输入,随着层数的叠加,整个模型能够理解你所输出数据的特征。

前面说到的Dreambooth相当于是把unet里的每一层函数都要进行微调,所以我们说她计算量大,训练时间长,模型体积大。

但是LoRA就不同了,LoRA旨在减少模型的训练参数,提升模型训练效率;LoRA建议冻结预训练模型的权重,并将训练参数注入到Transformar函数架构的每个层中,他的优点就是不破坏原有模型,即插即用。如下图红色部分所示:

正因为LoRA他的插入层较少,他相较于Dreambooth,可以把训练参数降低1000倍,对CPU的要求也会下降三倍,所以训练出来的LoRA模型就会非常小,一般大家在C站下载过就知道,往往他们只有几十m,而一个大模型往往有几个g,所以他在我们日常工作中变得非常常用。

大家作为新手学习的时候,可以理解Lora是在原有模型上添加一个“滤镜”,让这个底模往我们期望的效果走。如下图所示,我用了一个revAnimated(一个偏动漫的底模型),当我们Prompt不变的情况下,加了一个盲盒效果的LoRA之后,相当于是给这个底模型上了一个滤镜,让整体底模型出来的效果往盲盒方向偏重:

5 Embedding(Text Inversion)

接下来我们来讲一下Embedding,Embedding也叫Text inversion(大家在C站下载的时候注意这是一个东西,他主要是用于训练特定的人或物),它反映的是一个Prompt与对应向量的映射记录关系的算法,可以用于训练特定的人或物。

还记得上面讲我们的咒语是如何起作用的时候的这张图么?

我们说过CLIP模型是Text Encoder算法的一种,Text Encoder主要是把自然语义prompt转变为词特性向量Embedding,所以我们可以针对我们的Prompt到向量的这个映射过程进行训练,去修改他们之间的映射记录关系,从而达到训练特定的人或物的效果,由于他生成的是一套纯文字映射记录,所以体积非常小,一般只有几百k。举个实际应用的例子,比如下面这个人物大家都很熟悉,是守望先锋里的Dva:

举个实际应用的例子,比如下面这个人物大家都很熟悉,是守望先锋里的Dva:如果我们要通过描述她的特征去把她描述出来,可能要几千个prompt tag才行,那我如果每次想生成Dva都要再打一次这么多prompt肯定不科学,这时候我们可以把这一串tag打包映射成一个新的词汇叫OW_Dva。

由于这个词是我们自创的,在CLIP映射集合里找不到对应的映射关系,所以CLIP会默认给他创建一个新的映射空间,经过一系列训练之后,我们后续就可以通过输入一个简单的词汇来完成一系列tag的打包效果。

6 Hypernetwork

最后我们来看一下Hypernetwork,他作为一种即将要被Lora淘汰了的技术,我们大概略讲一下他的原理就好了。

大家先看下图,我们来总结一下三种技术的原理和在UNET中的使用范围:

Dreambooth调整了整个UNET的函数和参数,所以他体积最大,适用范围最全,但是训练难度和训练耗时和成本最大。LoRA只将训练参数注入到了部分Transformar函数中,所以他不改变原模型,即插即用,模型大小也可控,是我们后续学习的重点。

而Hypernetwork,大家看图,他是新建了一个单独的神经网络模型,插入到原UNet模型的中间层。在训练过程中,冻结所有参数,只训练插入部分,从而使输出图像与输入指令之间产生关联关系,同时只改变原模型的一小块内容。从这个原理的描述上,大家就能发现,Hypernetwork这种方法更适合用于训练某种画风,比如像素画之类的,大家在C站能找到的Hypernetwork模型也几乎都是画风训练的,但是不是说他不能训练别的,它也是可以训练人物的,就是比LoRA麻烦一点。

总之,他几乎是一个咋国内几乎要被LoRA淘汰的技术(注意是国内,注意是几乎,杠精别杠),大家去知乎什么的看paper,关于HyperNetworks的相关paper都在2022年前,所以大家就也把他当成一个”滤镜“来理解即可。

今天的分享就到这里,内容非常干,适合大家先看一遍,有个印象,以后在实操过程中哪里不懂可以再翻出来看。最后说一下声明:在本文中为了方便大家通俗理解,作者对算法原理进行了某种程度的简化,并不能代表模型函数运行的100%实质(防杠)。